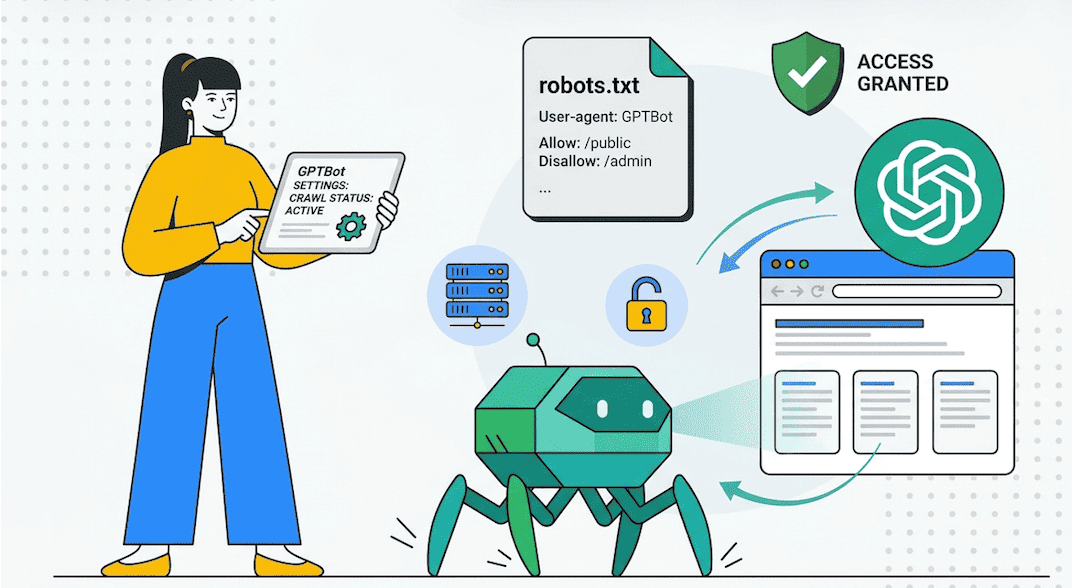

GPTBot sert à crawler du contenu public qui peut être utilisé pour l’entraînement des modèles fondamentaux d’OpenAI. Il ne pilote pas, à lui seul, votre visibilité dans ChatGPT Search. C’est la première confusion à corriger. La seconde est pire : croire qu’un simple “Disallow: GPTBot” équivaut à une stratégie GEO. Ce n’est pas une stratégie. C’est un réglage.

Le sujet n’est donc pas “faut-il bloquer GPTBot ?”. Le sujet est plus dur, plus utile, plus rentable : quels bots OpenAI voulez-vous autoriser, sur quelles sections du site, pour quel usage, avec quelle mesure business derrière ?

GPTBot ne fait pas ce que beaucoup croient

GPTBot n’est pas le bot utilisé pour faire remonter votre site dans les résultats de recherche de ChatGPT. Selon la documentation OpenAI, ce rôle revient à OAI-SearchBot. GPTBot, lui, sert au crawl de contenus pouvant être utilisés pour rendre les modèles génératifs plus utiles et plus sûrs. ChatGPT-User relève encore d’un autre usage : des accès déclenchés par une action utilisateur, pas d’un crawl automatique du web.

Le tableau ci-dessous résume la séparation réelle des rôles chez OpenAI, avec un point de comparaison côté Google pour éviter les analogies paresseuses.

| Bot | Rôle principal | Impact direct | Pilotage |

|---|---|---|---|

| Googlebot | Crawl et indexation pour Google Search | Visibilité Google | robots.txt + directives d’indexation |

| OAI-SearchBot | Présence dans les résultats de recherche ChatGPT | Visibilité ChatGPT Search | robots.txt |

| GPTBot | Crawl de contenus potentiellement utilisés pour l’entraînement des modèles | Gouvernance d’usage du contenu | robots.txt |

| ChatGPT-User | Visite ponctuelle déclenchée par un utilisateur ou un GPT | Accès à la demande | robots.txt pas toujours applicable selon OpenAI |

Le marché mélange encore ces couches. Résultat : on coupe GPTBot, on se félicite d’avoir “géré l’IA”, puis on laisse la vraie question sans réponse. Veut-on être trouvé dans ChatGPT Search ? Veut-on autoriser un usage d’entraînement ? Veut-on permettre l’accès temps réel lors d’une action utilisateur ? Ce sont trois décisions distinctes.

Pourquoi bloquer GPTBot n’est pas une stratégie GEO ?

Bloquer GPTBot peut être légitime. Si votre doctrine juridique ou éditoriale refuse que votre contenu serve à l’entraînement de futurs modèles, la consigne est cohérente. OpenAI l’indique noir sur blanc : désautoriser GPTBot signifie que le contenu du site ne doit pas être utilisé pour l’entraînement des modèles génératifs.

L’erreur commence quand cette décision est vendue comme une stratégie de visibilité. Ce n’en est pas une. Une stratégie GEO répond à une autre question : comment faire comprendre, sélectionner, citer et attribuer vos contenus dans des interfaces de réponse. À ce niveau, le sujet n’est plus seulement l’accès du bot. C’est la citabilité du contenu : blocs extractibles, entités nettes, preuve, structure, maillage, signaux d’autorité. C’est d’ailleurs la logique défendue par Oscar : le SEO devient la logistique de précision du GEO, pas son opposé.

Autrement dit : bloquer GPTBot peut protéger un usage. Cela ne construit aucune autorité conversationnelle.

Ce qui se passe vraiment quand vous bloquez ou autorisez les bots OpenAI

Scénario 1 : vous bloquez GPTBot, mais vous autorisez OAI-SearchBot

C’est le scénario le plus rationnel pour beaucoup de marques. Vous refusez l’usage du contenu pour l’entraînement, tout en laissant votre site apparaître dans ChatGPT Search. OpenAI précise bien que les réglages sont indépendants.

Scénario 2 : vous autorisez GPTBot, mais vous bloquez OAI-SearchBot

Vous acceptez l’usage potentiel de votre contenu pour les modèles, mais vous vous excluez des réponses de recherche ChatGPT. Ce choix peut exister. Il est rarement bon d’un point de vue acquisition. OpenAI indique que les sites exclus d’OAI-SearchBot ne seront pas affichés dans les réponses de recherche ChatGPT, même si des liens de navigation peuvent encore apparaître dans certains cas.

Scénario 3 : vous bloquez tout

C’est la posture “pare-feu idéologique”. Elle rassure parfois en interne. Elle coûte souvent plus qu’elle ne protège. Vous perdez la possibilité d’être sélectionné dans ChatGPT Search, sans pour autant traiter proprement les questions de désindexation fine ou de contenu sensible.

Scénario 4 : vous autorisez tout

C’est l’inverse du dogme défensif. Pas plus mature. Vous laissez entrer des usages différents sans hiérarchie métier. Pour une marque structurée, la bonne logique n’est ni l’ouverture totale ni le blocage total. C’est la segmentation.

Le vrai paradoxe du métier est là : un site peut être “ouvert” aux bons bots et rester invisible, simplement parce que ses contenus sont mal structurés. À l’inverse, un site très propre sémantiquement peut perdre une partie de sa visibilité IA si le mauvais bot est bloqué. Le GEO ne remplace donc pas la gouvernance crawl. Il l’oblige à devenir plus fine.

La bonne doctrine : segmenter, autoriser, mesurer

1. Séparer les usages

Ne pilotez pas OpenAI avec un seul bouton.

- GPTBot : décision de gouvernance sur l’usage du contenu pour l’entraînement

- OAI-SearchBot : décision d’acquisition sur la visibilité dans ChatGPT Search

- ChatGPT-User : décision d’accessibilité à la demande, avec une nuance clé, car OpenAI précise que robots.txt peut ne pas s’appliquer dans certains cas puisque l’accès est initié par l’utilisateur

2. Travailler par répertoires, pas en mode domaine entier

Tout ouvrir ou tout fermer à l’échelle du site est une paresse de gouvernance. Une marque sérieuse ne traite pas de la même manière :

- ses pages de services et pages piliers

- ses études de cas

- sa documentation produit

- ses contenus premium

- ses espaces sensibles, légaux ou à faible valeur

Exemple de configuration équilibrée pour une marque qui veut rester visible dans ChatGPT Search tout en refusant l’usage d’entraînement :

User-agent: GPTBot

Disallow: /

User-agent: OAI-SearchBot

Allow: /

Sitemap: https://www.votresite.com/sitemap.xml

Cette configuration ne suffit pas à elle seule. Elle pose juste la doctrine de base.

3. Ne pas confondre robots.txt et désindexation

Google le rappelle clairement : robots.txt sert surtout à indiquer quelles URLs un crawler peut demander. Ce n’est pas le bon mécanisme pour empêcher une page d’apparaître dans Google. Google recommande le noindex ou la protection par mot de passe selon le besoin. OpenAI ajoute une nuance comparable : si son système obtient l’URL d’une page non autorisée via un fournisseur tiers ou en explorant d’autres pages, il peut encore afficher un lien et un titre ; pour éviter cela, OpenAI renvoie au noindex, en précisant que le crawler doit pouvoir lire cette balise.

C’est le détail que les tutoriels faibles oublient. Bloquer n’est pas toujours masquer. Et masquer n’est pas toujours désindexer.

4. Mesurer enfin le sujet comme un canal

OpenAI indique que le trafic issu de ChatGPT Search peut être suivi via le paramètre utm_source=chatgpt.com. Donc oui, le sujet se pilote. Pas parfaitement. Pas avec les vieux KPIs seuls. Mais il se pilote.

Ce que doit suivre un CMO :

- sessions et conversions avec

utm_source=chatgpt.com - pages d’entrée issues de ChatGPT Search

- répertoires ouverts à OAI-SearchBot

- part des contenus “réponse-ready”

- citations de marque observées sur un panel de prompts métier

- logs serveurs pour vérifier le comportement réel des bots

Un canal non mesuré devient vite un débat d’opinion. C’est exactement ce qu’est devenu GPTBot chez beaucoup d’éditeurs.

GPTBot : comment le contrôler dans le fichier robots.txt ?

Pour gérer l’accès de GPTBot, le levier le plus direct reste le fichier robots.txt. Exemple de blocage total :

User-agent: GPTBot

Disallow: /

Exemple d’ouverture contrôlée sur certaines zones du site :

User-agent: GPTBot

Disallow: /espace-client/

Disallow: /documents-internes/

Disallow: /donnees-sensibles/

Ce type de configuration permet de protéger les répertoires sensibles tout en laissant accessibles les contenus conçus pour exister dans l’écosystème de l’intelligence artificielle.

Ce qu’un CMO doit décider maintenant

La décision n’est pas technique. Elle est politique.

- Question 1 : voulez-vous que votre marque puisse apparaître dans ChatGPT Search ?

Si oui, ne bloquez pas OAI-SearchBot. - Question 2 : acceptez-vous que des contenus publics servent potentiellement à l’entraînement des modèles OpenAI ?

Si non, bloquez GPTBot. - Question 3 : quels contenus méritent vraiment une visibilité conversationnelle ?

Probablement vos pages piliers, comparatifs, guides experts, études de cas, FAQ solides, contenus où votre entité est la plus claire. - Question 4 : vos contenus sont-ils extractibles ?

Si la réponse est non, autoriser le bon bot ne changera presque rien. Un contenu noyé dans le bruit, vague sur les entités, pauvre en preuves, faible en structure, reste médiocre pour Google comme pour un moteur conversationnel. Oscar le formule bien : la logique n’est plus seulement celle du lien bleu, mais celle de la source de vérité exploitable par des systèmes RAG.

La vraie erreur en GEO n’est donc pas de bloquer GPTBot. La vraie erreur est de croire que ce geste clôt le sujet. Il ne fait que l’ouvrir.

GPTBot sert-il à faire remonter mon site dans ChatGPT Search ?

Non. OpenAI indique qu’OAI-SearchBot est utilisé pour faire remonter les sites dans les fonctionnalités de recherche de ChatGPT. GPTBot concerne le crawl de contenus pouvant être utilisés pour l’entraînement des modèles.

Puis-je bloquer GPTBot tout en restant visible dans ChatGPT ?

Oui, si vous laissez OAI-SearchBot autorisé. OpenAI précise que les réglages sont indépendants. C’est même l’option la plus logique pour beaucoup d’éditeurs qui veulent séparer visibilité et entraînement.

Bloquer OAI-SearchBot suffit-il pour disparaître complètement de ChatGPT ?

Pas forcément. OpenAI explique qu’un lien et un titre peuvent encore apparaître si l’URL est connue via un fournisseur tiers ou d’autres signaux. Pour empêcher cela, OpenAI renvoie au noindex, avec une condition importante : le crawler doit pouvoir lire cette balise

robots.txt suffit-il pour retirer une page de Google ou d’un moteur IA ?

Non. Google indique que robots.txt n’est pas un mécanisme de retrait d’une page des résultats. Côté OpenAI, la FAQ renvoie aussi au noindex pour empêcher certains affichages résiduels.

Comment mesurer le trafic venant de ChatGPT Search ?

OpenAI indique que ChatGPT ajoute automatiquement utm_source=chatgpt.com aux URLs de référence, ce qui permet de suivre ce trafic dans vos outils analytics.

ChatGPT-User fonctionne-t-il comme un crawler classique ?

Non. OpenAI dit que ChatGPT-User n’est pas utilisé pour crawler automatiquement le web. Il intervient lors d’actions déclenchées par l’utilisateur, et robots.txt peut ne pas s’appliquer dans ce cadre.

Retour

Retour Partager

Partager